In den analogen Tagen der 1970er Jahre, lange bevor Hacker, Trolle und Edgelords, eine Firma für Audiokassetten, entwickelte ein Werbeslogan der eine Fangfrage enthielt: „Ist es live oder ist es Memorex?“ Die Nachricht spielte mit der Realität und suggerierte, dass es keinen Unterschied in der Klangqualität zwischen einer Live-Performance und auf Band aufgenommener Musik gibt.

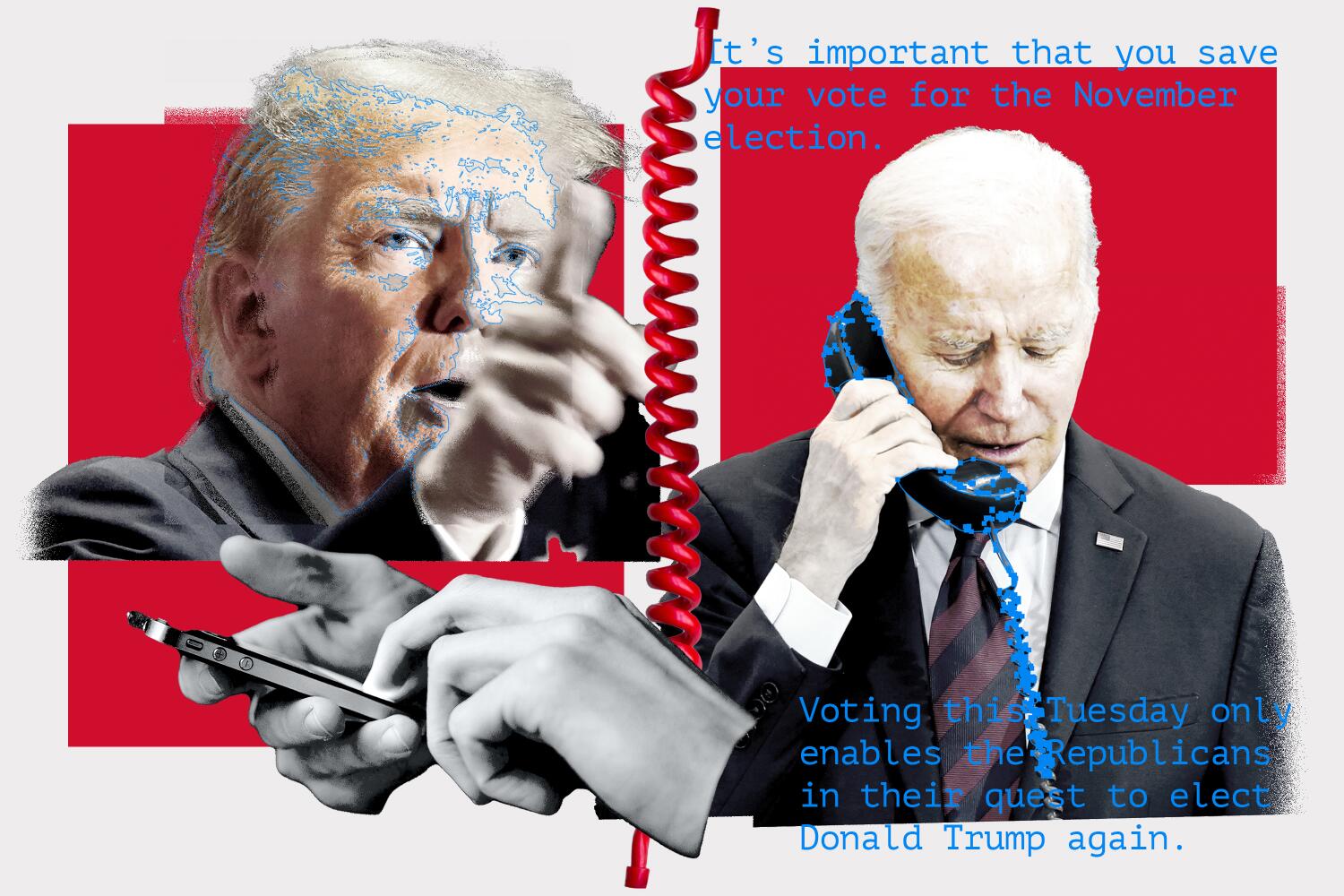

In unserem Zeitalter der Lügen und Täuschungen im Metaversum könnte man sich ähnliche Fragen darüber stellen, was real ist und was nicht: Ruft Präsident Biden die Demokraten per Robocall an, damit sie nicht wählen gehen? Ist Donald Trump der sich mit schwarzen Männern auf einer Veranda anbiedert? Ziehen die USA in den Krieg mit Russland? In einem Wahljahr, in dem KI-generierte Inhalte die Wähler in einer Weise ansprechen, die früher unvorstellbar war, scheinen Fakten und Fiktion austauschbar zu sein.

Die amerikanische Politik ist an Schikanen gewöhnt – Gegner von Thomas Jefferson warnten die Öffentlichkeit im Jahr 1800, er würde ihre Bibeln verbrennen würde wenn sie gewählt werden – aber künstliche Intelligenz verbiegt die Realität in eine Videospielwelt von Avataren und Deepfakes, die Verwirrung und Chaos stiften sollen. Die Fähigkeit von KI-Programmen, schnell und umfassend Desinformationen zu produzieren und zu verbreiten, ist die Waffe von einsamen Provokateuren und Geheimdiensten in Russland, China und Nordkorea.

(Alex Brandon / Associated Press)

„Die Wahrheit selbst wird schwer zu entschlüsseln sein. Den Kandidaten, Verschwörungstheoretikern, ausländischen Staaten und Online-Trollen, die die Wähler täuschen und das Vertrauen in unsere Wahlen untergraben wollen, werden mächtige, leicht zugängliche neue Werkzeuge zur Verfügung stehen“, sagte Drew Liebert, Direktor des Kalifornischen Initiative für Technologie und Demokratieoder CITED, die eine Gesetzgebung zur Begrenzung von Desinformation anstrebt. „Stellen Sie sich einen gefälschten Robocall vor [from] Gouverneur Newsom wendet sich am Vorabend des Wahltages an Millionen von Kaliforniern und teilt ihnen mit, dass sich ihr Wahllokal geändert hat.“

Die Drohung kommt zu einer Zeit, in der eine polarisierte Wählerschaft immer noch die Nachwirkungen einer Pandemie spürt, die viele Amerikaner in sich gekehrt hat und die Abhängigkeit vom Internet erhöht. Die Verbreitung von Desinformationen hat sich beschleunigt, da das Misstrauen gegenüber Institutionen wächst und Wahrheiten durch Kampagnen und soziale Medien, die von Konflikten leben, verzerrt werden. Die Amerikaner sind sowohl empfänglich als auch misstrauisch gegenüber KI, nicht nur wegen ihres Potenzials, spaltende Themen wie Rasse und Einwanderung auszunutzen, sondern auch wegen ihrer Science-Fiction-ähnlichen Zauberei, um Arbeitsplätze zu stehlen und die Art und Weise, wie wir leben, neu zu ordnen.

Russland hat eine Welle von Hackerangriffen und Täuschungen inszeniert, um die US-Wahl 2016 zu stören. Die Bots der Desinformation waren im Januar eine Macht, als China sich erfolglos in die Wahlen in Taiwan einmischte, indem es gefälschte Nachrichtensprecher schuf. Eine aktuelle Bedrohungsanalyse von Microsoft besagt, dass ein von China gesponsertes Netzwerk, das als Spamouflage bekannt ist, KI-Inhalte und Konten in sozialen Medien nutzt, um „im Vorfeld der US-Präsidentschaftswahlen Informationen über wichtige demografische Merkmale der Wähler zu sammeln.“

Eine chinesische Desinformationskampagne behauptet laut dem Microsoft-Bericht, die US-Regierung habe die Waldbrände auf Maui im Jahr 2023 absichtlich gelegt, um „eine militärische ‚Wetterwaffe‘ zu testen.“

Eine neue Studie des Polarization Research Lab wies auf die Ängste hin, die die Amerikaner vor künstlicher Intelligenz haben: 65% sorgen sich um die Verletzung der Privatsphäre, 49,8% erwarten, dass KI die Sicherheit von Wahlen negativ beeinflussen wird und 40% glauben, dass KI der nationalen Sicherheit schaden könnte. Eine Umfrage im November von UC Berkeley ergab, dass 84% der kalifornischen Wähler über die Gefahren von Fehlinformationen und KI-Depfakes während des Wahlkampfs 2024 besorgt sind.

Mehr als 100 Gesetzesvorlagen wurden in mindestens 39 Staaten eingebracht, um KI-generiertes Material einzuschränken und zu regulieren, so die Voting Rights Lab, eine unparteiische Organisation, die wahlbezogene Gesetze verfolgt. In Kalifornien werden mindestens vier Maßnahmen vorgeschlagen, darunter Gesetzentwürfe der Abgeordneten Buffy Wicks (D-Oakland) und Marc Berman (D-Menlo Park), die KI-Unternehmen und Social Media-Plattformen verpflichten würden, Wasserzeichen und andere digitale Herkunftsdaten in KI-generierte Inhalte einzubetten.

„Dies ist ein entscheidender Moment. Als Gesetzgeber müssen wir die Öffentlichkeit verstehen und schützen“, sagte Adam Neylon, ein republikanischer Abgeordneter in Wisconsin, das ein überparteilichen Gesetzentwurf im Februar, um politische Gruppen und Kandidaten mit einer Geldstrafe von 1.000 Dollar zu bestrafen, wenn sie keine Haftungsausschlüsse zu AI-Werbeanzeigen hinzufügen. „So viele Menschen misstrauen den Institutionen. Das hat sich mit der Fragmentierung der Medien und der sozialen Medien verflüchtigt. Wenn Sie KI in diesen Mix einbringen, könnte das ein echtes Problem werden.“

Einem Bericht von Microsoft zufolge behauptete eine chinesische Desinformationskampagne, die US-Regierung habe die Waldbrände auf Maui im Jahr 2023 absichtlich gelegt, um „eine militärische ‚Wetterwaffe‘ zu testen.“

(Washington Post)

Seit ChatGPT im Jahr 2022 eingeführt wurde, hat die KI für Faszination gesorgt, weil sie die Art und Weise, wie Operationen durchgeführt werden, wie Musik gemacht wird, wie Armeen eingesetzt werden und wie Flugzeuge geflogen werden, neu gestalten kann. Ihre erschreckende Fähigkeit, Unfug zu treiben und Bilder zu fälschen, kann harmlos sein – Papst Franziskus trug im Vatikan einen Designer-Puffmantel – und kriminell. Fotografien von Kindern wurden zu Pornografie manipuliert. Experten warnen vor fahrerlosen Autos, die zu Waffen werden und die Cyberangriffe auf Stromnetze und Finanzinstitute sowie die Gefahr einer nuklearen Katastrophe.

Die Raffinesse der politischen Täuschung deckt sich mit dem Misstrauen vieler Amerikaner – die Verschwörungstheoretikern wie der Abgeordneten Marjorie Taylor Greene (R-Ga.) Glauben schenken – in die Integrität der Wahlen. Der Aufstand im Kapitol am 6. Januar 2021 war das Ergebnis einer Fehlinformationskampagne, die Radikale im Internet auf den Plan rief und die Demokratie der Nation bedrohte, weil falsche Behauptungen aufgestellt wurden, dass die Wahl 2020 von Trump gestohlen wurde. Diese Fantasien haben sich bei vielen Anhängern des ehemaligen Präsidenten verstärkt und sind ein fruchtbarer Boden für KI-Täuschungsmanöver.

Eine kürzlich veröffentlichte Global Risks Report des Weltwirtschaftsforums warnte, dass Desinformationen, die neu gewählte Regierungen untergraben, zu Unruhen wie gewalttätigen Protesten, Hassverbrechen, zivilen Auseinandersetzungen und Terrorismus führen können.

Doch bisher haben KI-generierte Inhalte die diesjährigen Wahlen weltweit nicht gestört, auch nicht in Pakistan und Bangladesch. Politische Lügen konkurrieren um Aufmerksamkeit in einem viel größeren Rauschen der sozialen Medien, das alles umfasst, von Beyoncés neuestem Album bis zu den seltsamen Dingen, die Katzen tun. Deepfakes und andere Täuschungen, darunter manipulierte Bilder von Trump, der das Frühstück in einem Waffle House serviert und Elon Musk die mit Kryptowährungen hausieren gehen, werden schnell entlarvt und diskreditiert. Und in den USA, wo die jahrelange Parteipolitik Gefühle und Loyalitäten verhärtet hat, ist es weniger wahrscheinlich, dass Desinformationen die Wähler beeinflussen.

„Erstaunlich wenige Menschen sind unentschlossen, wen sie unterstützen“, sagte Justin Levitt, ein Verfassungsrechtler und Professor an der Loyola Law School. Er fügte hinzu, dass die Isolation während der Pandemie, als sich viele in virtuelle Welten zurückzogen, nachlässt, da der Großteil der Bevölkerung zu einem Leben vor der COVID zurückkehrt.

„Wir haben Einfluss auf unsere Beziehungen“, sagte er, was die Wahrscheinlichkeit verringert, dass groß angelegte Desinformationskampagnen Erfolg haben werden. „Unsere Verbindungen untereinander werden die Auswirkungen verringern.“

Die Non-Profit-Organisation TrueMedia.org bietet Tools für Journalisten und andere, die daran arbeiten, KI-generierte Lügen zu erkennen. Die Website listet eine Reihe von Deepfakes auf, darunter die Verhaftung von Trump durch einen Schwarm von New Yorker Polizisten, ein Foto von Präsident Biden in Armeeuniform, das während des Hamas-Angriffs auf Israel im letzten Jahr gepostet wurde, und ein Video von Manhattans Bezirksstaatsanwalt Alvin L. Bragg, der zurücktritt, nachdem er Trump in der aktuellen Schweigegeldaffäre freigesprochen hat.

NewsGuard spürt auch KI-Lügen auf und deckt sie auf, einschließlich der jüngsten Bot-Fälschungen von Hollywood-Stars, die russische Propaganda gegen die Ukraine unterstützen. In einem Video erzählt Adam Sandler, dessen Stimme gefälscht und auf Französisch synchronisiert wurde, Brad Pitt, dass der ukrainische Präsident Wolodymyr Zelensky „kooperiert mit Nazis“. Das Video wurde 600 Mal auf der sozialen Plattform X gepostet.

Die Bundeskommission für Kommunikation hat vor kurzem ein Verbot erlassen KI-generierte Robo-Anrufe, und der Kongress drängt Tech- und Social-Media-Unternehmen, die Flut der Täuschungen einzudämmen.

Im Februar verpflichteten sich Meta, Google, TikTok, OpenAI und andere Unternehmen, die „angemessene Vorkehrungen“ zu treffen durch das Anbringen von Haftungsausschlüssen und Kennzeichnungen an KI-generierten politischen Inhalten. Die Erklärung war nicht so stark oder weitreichend, wie einige Wahlbeobachter gehofft hatten, aber sie wurde von führenden Politikern in den USA und Europa unterstützt, in einem Jahr, in dem die Wähler in mindestens 50 Ländern zu den Urnen gehen werden, darunter auch in Indien, El Salvador und Mexiko.

„Ich bin ziemlich negativ gegenüber Unternehmen der sozialen Medien eingestellt. Sie tun absichtlich nichts, um das zu verhindern“, sagte Hafiz Malik, Professor für Elektro- und Computertechnik an der University of Michigan-Dearborn. „Ich kann nicht glauben, dass milliarden- und milliardenschwere Unternehmen nicht in der Lage sind, dieses Problem zu lösen. Sie tun es nicht. Bei ihrem Geschäftsmodell geht es um mehr Aktien, mehr Klicks, mehr Geld.“

Malik arbeitet schon seit Jahren an der Erkennung von Deepfakes. Er erhält oft Anrufe von Faktenprüfern, die Video- und Audioinhalte analysieren sollen. Auffallend sei die rasche Entwicklung von KI-Programmen und -Tools, die die Desinformation demokratisiert haben. Bis vor ein paar Jahren, sagte er, konnten nur staatlich geförderte Unternehmen solche Inhalte erzeugen. Heute sind die Angreifer viel raffinierter und bewusster. Sie fügen dem Inhalt Rauschen oder Verzerrungen hinzu, um die Erkennung von Fälschungen zu erschweren. auf Plattformen wie X und Facebook.

Künstliche Intelligenz hat jedoch Grenzen, wenn es darum geht, Kandidaten nachzubilden. Die Technologie könne die Sprachmuster, die Intonation, die Gesichtszüge und die Emotionen eines Menschen nicht genau erfassen. „Sie können flach und monoton wirken“, fügte Malik hinzu, der politische Inhalte aus den USA, Nigeria, Südafrika und Pakistan untersucht hat, wo die Anhänger des inhaftierten Oppositionsführers Imran Khan seine Stimme geklont und einen Avatar für virtuelle politische Kundgebungen geschaffen. KI-generierte Inhalte werden „eine gewisse Spur hinterlassen“, so Malik. Er deutet jedoch an, dass die Technologie in Zukunft Personen noch genauer imitieren könnte.

„Dinge, die vor ein paar Jahren noch unmöglich waren, sind jetzt möglich“, sagte er. „Das Ausmaß der Desinformation ist unvorstellbar. Die Kosten für die Produktion und Verbreitung sind minimal. Man braucht nicht allzu viel Know-how. Mit einem Klick auf eine Schaltfläche können Sie die Informationen so weit verbreiten, dass sie sich selbständig verbreiten können. Sie können ein Mikroziel anvisieren.“

Technologie- und Social-Media-Plattformen haben Daten über zig Millionen Amerikaner gesammelt. „Die Leute kennen Ihre Vorlieben bis hin zu Ihren Schuhen“, sagte die ehemalige US-Staatsanwältin Barbara McQuade, Autorin von „Attack from Within: How Disinformation Is Sabotaging America“. Solche persönlichen Details ermöglichen es Trollen, Hackern und anderen, die KI-generierte Desinformationen produzieren, sich in den Stunden unmittelbar vor der Stimmabgabe auf bestimmte Gruppen oder strategische Wahlbezirke in Swing States zu konzentrieren.

„Dort kann der größte Schaden angerichtet werden“, sagte McQuade. Der gefälschte Biden-Anruf, der die Leute aufforderte, in New Hampshire nicht zur Wahl zu gehen, sagte sie, „war unbedeutend, weil es eine unumstrittene Vorwahl war. Aber im November, wenn auch nur ein paar Leute das gehört und geglaubt haben, könnte das den Unterschied im Wahlausgang ausmachen. Oder nehmen wir an, Sie erhalten eine von der KI generierte Nachricht oder eine SMS, die aussieht, als käme sie vom Außenministerium oder einem Bezirksbeamten, die besagt, dass in dem Wahllokal, in dem Sie wählen, der Strom ausgefallen ist und die Wahl auf Mittwoch verschoben wurde.“

Die neuen KI-Tools, sagte sie, „ermutigen die Leute, weil das Risiko, erwischt zu werden, gering ist und man einen echten Einfluss auf eine Wahl haben kann“.

Hacker haben ein KI-manipuliertes Video hochgeladen, das den ukrainischen Präsidenten Volodymyr Zelensky zeigt, wie er seine Truppen zur Kapitulation auffordert.

(Francisco Seco / Associated Press)

Im Jahr 2022 nutzte Russland Deepfake, um seinen Krieg mit der Ukraine zu beenden. Hacker luden ein KI-manipuliertes Video hoch, das den ukrainischen Präsidenten Wolodymyr Zelensky und befahl seinen Truppen, sich zu ergeben. Im selben Jahr kandidierte Cara Hunter für einen Sitz in der nordirischen Legislative, als ein Video von ihr, in dem sie angeblich eindeutigen Sex hat, viral ging. Der von der Künstlichen Intelligenz generierte Clip kostete sie zwar nicht die Wahl – sie gewann knapp – aber die Folgen waren tiefgreifend.

„Wenn ich sage, dass dies die schrecklichste und stressigste Zeit meines Lebens war, dann übertreibe ich nicht“, wurde sie im Belfast Telegraph zitiert. „Können Sie sich vorstellen, dass Sie in den letzten 20 Tagen jeden Tag aufgewacht sind und Ihr Telefon ständig mit Nachrichten geklingelt hat?

„Selbst wenn ich in den Laden gehe“, fügte sie hinzu, „sehe ich, dass die Leute mir gegenüber unangenehm sind, und das stellt Ihre Integrität, Ihren Ruf und Ihre Moral in Frage.“

https://www.latimes.com/politics/story/2024-04-30/will-a-i-deepfake-videos-and-robocalls-threaten-the-2024-election?rand=723

Es handelt sich hierbei um Veröffentlichungen von der Tageszeitung Los Angeles Times aus den USA. Wir haben diese lediglich übersetzt. Dies soll eine Möglichkeit der freien Willensbildung darstellen. Mehr über uns erfahrt Ihr auf „Über Uns“